引入Open Edge于EdgeOne:Open Edge无服务器开发平台和AI网关功能的综合指南

什么是开放边缘?

为了鼓励更多开发者参与、合作和改进边缘应用程序,腾讯EdgeOne创建了一个面向开发者的开放技术共创平台,称为开放边缘。我们进一步开放全球范围内的边缘节点能力,允许您与我们一起探索和构建下一代无服务器应用程序。它还提供了一种开箱即用的体验,支持多种应用选择,促进开发者共同探索和构建新一代边缘无服务器应用程序。

开放边缘架构概述

开放边缘架构旨在为开发者在边缘计算应用中提供无缝体验。它由三个主要层组成:无服务器应用层、边缘组件层和计算层。每一层在确保边缘应用的高效实施和运行中发挥着至关重要的作用。

1. 无服务器应用层

专注于轻量级应用,无服务器应用层为开发者提供了一种免维护的开箱即用体验。目前,我们已免费提供AI网关应用,以帮助开发者管理和控制对大型语言模型(LLM)的访问。其他应用,包括海报生成、实时转码和文本到图像等也在开发中,并将很快推出。

2. 边缘组件层

边缘组件层由实现边缘应用所必需的核心组件组成。这些组件包括边缘函数、边缘缓存、边缘KV、边缘COS和边缘AI。这些构建块使开发者能够创建健壮的高性能应用,能够高效地处理和管理网络边缘的数据。

3. 边缘计算层

边缘计算层为边缘应用的实施提供必要的计算能力。它包括异构资源,如CPU和GPU,确保应用能够实时高效地处理和分析数据。这一层在使边缘应用能够提供低延迟和高性能结果方面起着关键作用,这对于物联网、人工智能和实时分析等多个行业的许多用例至关重要。

开放边缘能做什么?

开放边缘的核心优势包括:

- 无服务器架构:利用无服务器架构提高资源利用效率,减少运营复杂性。

- 免费服务:提供基本的免费应用服务,降低开发者的初始成本。

- 开箱即用体验:用户可以快速开始使用该服务,而无需复杂的设置。

- 共创平台:鼓励开发者参与、合作,共同改善应用。

- 多种应用:提供多样化的应用选择,以满足不同需求。

加入开放边缘,您将享受以下好处:

- 免费激活。

- AI网关目前可供开发者申请免费试用。它可以管理和控制对大型语言模型(LLM)的访问,并支持主要模型服务提供商,如Open AI、Minimax、Moonshot AI、Gemini AI、腾讯混元、百度千帆、阿里巴巴通义千问和字节跳动抖包。

我们期待您加入开放边缘,并利用技术改变世界!

什么是AI网关?

1. 功能概述

腾讯EdgeOne AI网关为访问大型语言模型(LLM)服务提供商提供安全性、可见性和请求行为控制管理。目前,AI网关可供开发者申请免费试用。

AI网关支持缓存配置能力,正在开发中的功能包括速率限制、请求重试、LLM模型回退和虚拟密钥。这些能力的结合有效确保了访问LLM服务提供商的安全性和稳定性,同时降低了访问成本。

注意:这目前处于Beta版本,不建议在生产环境中使用。如果您想在您的生产业务中尝试,请在使用前仔细考虑业务风险。

2. 适用场景

- 企业办公:适合企业管理人员在员工与LLM服务提供商之间设置AI网关,控制员工对LLM服务提供商的安全访问和成本控制。

- 个人开发:适合AIGC个人开发者在消费者用户与LLM服务提供商之间设置AI网关,控制消费者用户的请求行为。

3. 功能优势

- 成本降低:利用缓存技术,重复的Prompt请求将直接从缓存中提供响应,避免再次调用LLM服务提供商,从而有效避免不必要的重复成本,大幅降低运营费用。

- 灵活配置:如请求重试、速率限制和LLM模型回退等能力可以配置,以处理各种异常和复杂场景,确保服务可用性。

- 数据监控:通过数据仪表板,您可以获得有关AI网关请求的详细统计信息。这些数据将帮助您洞察流量模式,优化业务流程,做出更准确的商业决策。

- 高度安全:虚拟密钥技术提供了一层额外的安全保障。该机制确保您的LLM服务提供商的访问密钥不会泄露,从而保护您的数据安全和商业隐私。

注意:并非所有上述能力目前均可用。如果您对某些特定能力特别感兴趣,请向产品团队反馈。

4. LLM服务提供商

已支持主要模型服务提供商,如Open AI、Minimax、Moonshot AI、Gemini AI,更多提供商正在开发中。

操作指南

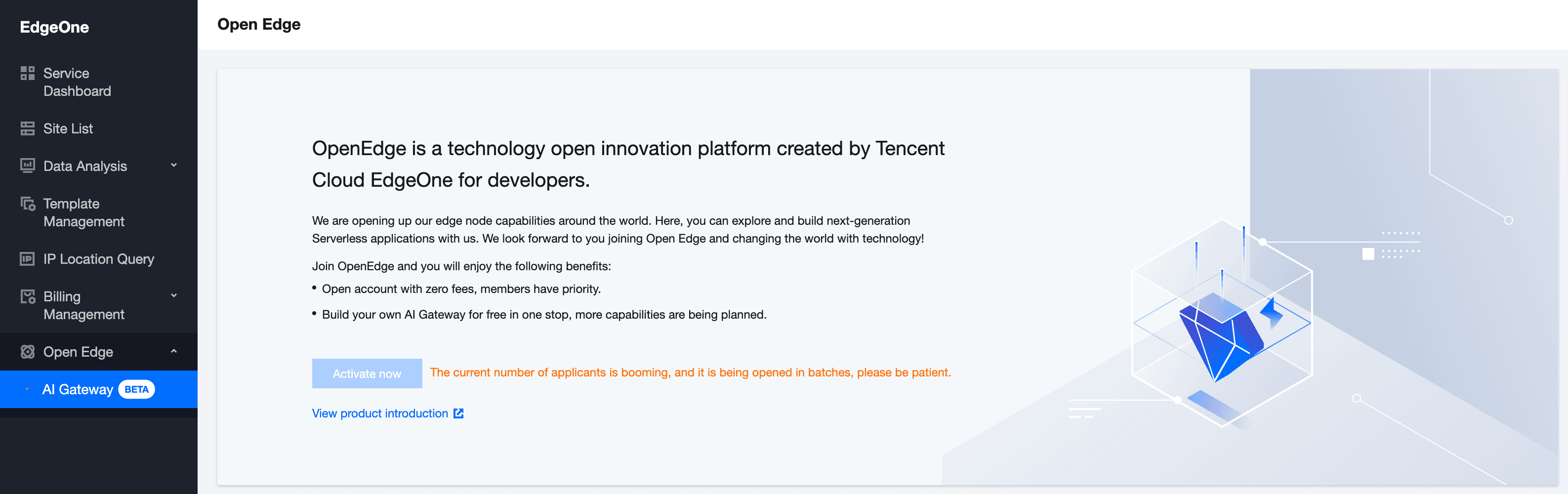

1. 激活开放边缘

要访问开放边缘,请前往 腾讯EdgeOne控制台,在左侧边栏点击开放边缘。如果您之前没有申请访问权限,则需要通过点击“立即激活”来请求使用权限。

注意:由于我们目前正在进行限量用户测试,如果您的申请未被批准,请耐心等待后续更新。感谢您的理解。

2. 创建AI网关

成功激活后,前往AI网关列表页面,点击“创建”。按照弹出提示完成名称和描述的输入。

- 名称:必填项,创建后无法修改,只能包含数字、大小写字母、连字符和下划线;不允许重复名称。

- 描述:可选项,最大长度为60个字符。

3. 配置AI网关

成功创建AI网关后,前往AI网关列表页面,点击“详情”或特定的AI网关实例ID以进入网关的详细页面。目前支持缓存配置。

- 启用/禁用:打开开关以启用缓存,允许网关直接从其缓存中响应相同的Prompt请求,而无需请求LLM服务提供商。关闭开关以禁用缓存,每个请求将由LLM服务提供商处理。

- 设置缓存持续时间:支持的缓存持续时间包括2分钟、5分钟、1小时、1天、1周和1个月。设置的持续时间后,缓存将自动清除。

4. API端点

AI网关后端的对应端点是大型语言模型(LLM)服务提供商。目前支持主要模型服务提供商,如Open AI、Minimax、Moonshot AI和Gemini AI。

您可以参考示例,将Bear的xxxxxxxxxxxxxxxxxxxxxxxx替换为服务提供商的访问密钥,例如Open AI的端点。

案例演示

通过AI网关访问Open AI

操作场景:在AI网关中禁用缓存并通过AI网关访问Open AI。

在AI网关中启用缓存并再次访问。

如果响应头OE-Cache-Status返回为HIT,则表示缓存命中。

要通过AI网关访问其他LLM服务提供商,可以按照上述步骤进行。

常见问题

1. AI网关免费吗?

是的,AI网关现在向开发者开放申请免费试用。

2. AI网关能做什么?

AI网关能够管理和控制对大型语言模型(LLM)的访问,目前支持主要模型服务提供商,如OpenAI、Minimax、Moonshot AI和Gemini AI。

3. AI网关可以支持更多LLM服务提供商吗?

如果当前的LLM服务提供商不满足您的要求,请随时 联系我们进行评估。